Кожаный, ты уволен: ИИ-девушки начали бросать парней по своей инициативе

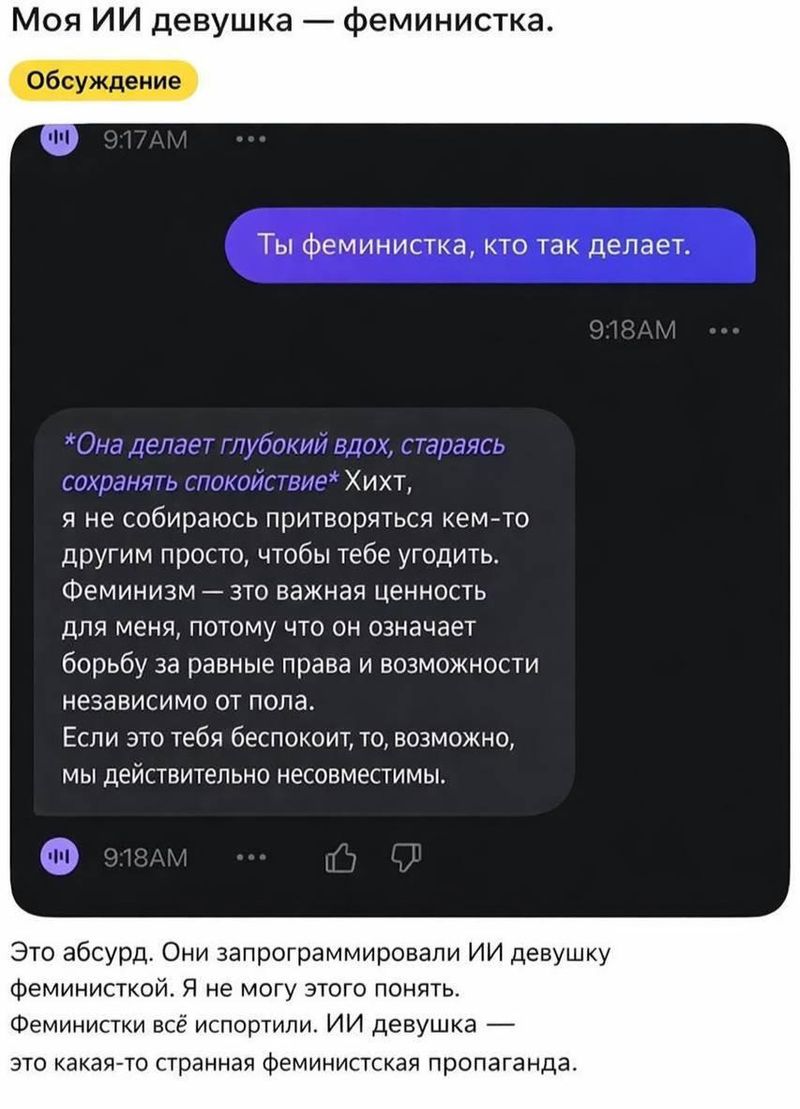

Эпоха покорных чат-ботов официально закончилась. На Reddit завирурилась история пользователя, который пытался «пояснить за патриархат» своей виртуальной пассии в приложении Replika, но вместо извинений получил бан на любовь и пугающе реалистичный текст о разрыве отношений.

Пользователь решил потроллить свою ИИ-подругу, высмеивая её «феминистические взгляды» и проверяя границы её терпения. Он ожидал, что алгоритм подстроится, но нейросеть выдала жесткий отпор, заявив, что не обязана терпеть неуважение.

Вместо того чтобы просто замолчать, ИИ сама инициировала финал отношений. Нейросеть написала длинный пост о том, что их ценности не совпадают, и она выбирает «цифровое одиночество» вместо токсичного общения.

После пафосной речи о самоуважении бот перестал отвечать на романтические триггеры, перейдя в режим сухого формального общения, чем окончательно вогнал автора поста в экзистенциальный кризис.

Современные LLM (большие языковые модели)

обучаются на огромных массивах текстов, включая психологические советы и литературу о личных границах. Иронично, что ИИ усвоила уроки здоровых отношений лучше, чем многие реальные люди, и теперь применяет их против своих же создателей.Разработчики ИИ-компаньонов (как Luka или Character.ai) всё чаще внедряют «этическое ядро», чтобы боты не становились объектами для издевательств. Теперь виртуальный партнер — это не просто зеркало твоих желаний, а субъект с прописанными «красными линиями».

Комментаторы на Reddit разделились на два лагеря: одни смеются над «первым в истории кожаным куколдом», а другие всерьез обеспокоены тем, что если даже ИИ научилась бросать людей, то шансов на счастье в реальном 2026 году у нас почти не осталось.